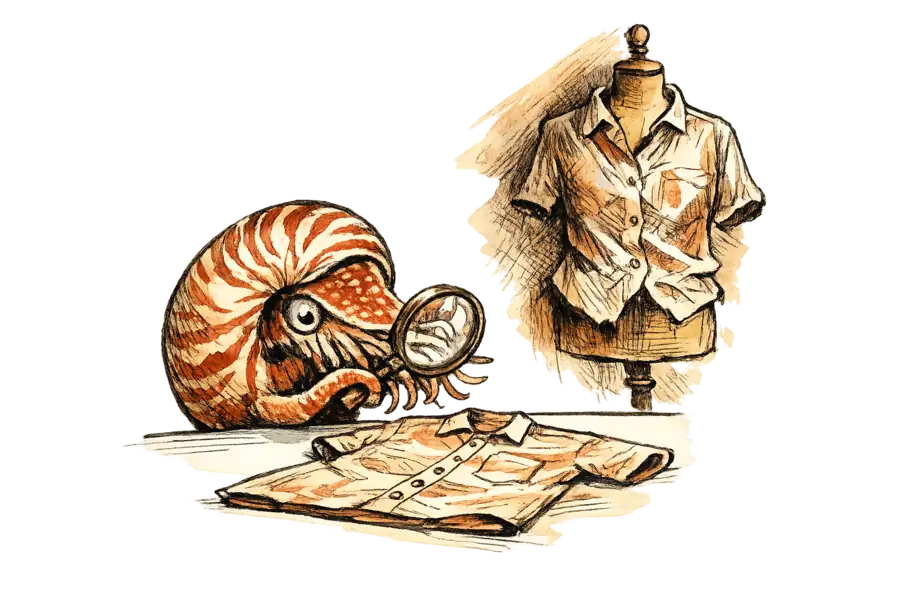

Das Rekonstruktionsproblem, das Virtual Try-On nie gelöst hat

Virtual Try-Off rekonstruiert kanonische Produktbilder von Kleidungsstücken aus Fotos bekleideter Personen – und schließt damit die Lücke in der Retourenabwicklung, im Wiederverkauf und der Katalogautomatisierung, die ein Jahrzehnt Try-On-Forschung nie angegangen ist.

Neritus Vale

Virtual Try-On hat ein Jahrzehnt an Forschungsgeldern und Retail-Pilotbudgets verschlungen, um eine einzige Frage zu beantworten: Wie sieht dieses Kleidungsstück an mir aus? Die umgekehrte Frage erhielt ihre erste formale Definition erst im November 2024, als Forscher der Universität Bielefeld den Begriff „Virtual Try-Off” prägten und TryOffDiff veröffentlichten: Ausgehend von einem Foto einer bekleideten Person wird ein sauberes, standardisiertes Produktbild des Kleidungsstücks selbst rekonstruiert. Genau diese zweite Frage ist es, auf die Retourenabwicklung, Wiederverkaufsplattformen und Katalogautomatisierung seit Jahren gewartet haben.

Die Aufgabe klingt simpel; die technische Umsetzung ist es nicht. Ein Kleidungsstück am Körper ist verdeckt, zerknittert, aus einem beliebigen Winkel beleuchtet und durch die Körperhaltung verformt. TryOffDiff adaptierte Stable Diffusion mit SigLIP-basierter visueller Konditionierung, wurde auf dem VITON-HD-Datensatz mit 11.552 Bildpaaren trainiert und übertraf sämtliche Baselines bei Wahrnehmungsqualitätsmetriken. Bis Mai 2025 stellte TEMU-VTOFF eine duale Diffusion-Transformer-Architektur vor, die mehrere Kleidungskategorien verarbeitet und auf der ICLR 2026 angenommen wurde. OmniDiT, im März 2026 veröffentlicht, entwickelte ein einheitliches Try-On- und Try-Off-Framework auf Basis von 380.000 Bildpaaren. Das Repository awesome-virtual-try-off verfolgt inzwischen 41 Paper, von denen die meisten im Jahr nach TryOffDiffs Debüt im November 2024 erschienen sind.

Virtual Try-On hat Tausende von Papern und Milliarden an Risikokapital hervorgebracht – ohne jemals ein Kleidungsbild zu liefern, das zum Wiederverkauf gelistet werden könnte.

Die National Retail Federation schätzt, dass Retouren im US-Einzelhandel 2025 einen Wert von 849,9 Milliarden Dollar erreichen werden, wobei Online-Käufe zu 19,3 Prozent zurückgegeben werden. Bekleidung steht dabei an der Spitze der Retourenkurve, mit Kategorieraten, die routinemäßig 20 bis 30 Prozent erreichen und in einigen Segmenten 50 Prozent übersteigen. Jedes zurückgegebene Kleidungsstück, das wieder ins Lager geht, benötigt ein Produktbild für die Neulistung – und die traditionelle Produktfotografie schlägt bei der Neufotografie einzelner Artikel mit 25 bis 75 Dollar pro Aufnahme für eine einfache Kataloglistung zu Buche. Try-On versprach, Retouren zu reduzieren, indem Käufer die Passform vor dem Kauf visualisieren können. Dieses Versprechen adressiert die obere Seite des Funnels; über das, was nach der Rücksendung passiert, sagt es nichts aus.

Der Secondhand-Markt verschärft das Bildproblem in einem anderen Maßstab. ThredUps Resale-Report 2026 prognostiziert, dass der weltweite Secondhand-Bekleidungsmarkt bis 2030 auf 393 Milliarden Dollar anwachsen wird, wobei der US-amerikanische Online-Wiederverkauf von 29,7 Milliarden Dollar im Jahr 2025 auf 48,3 Milliarden Dollar bis 2030 nahezu verdoppelt werden soll. Jedes dieser Kleidungsstücke tritt in die Pipeline ein, ohne ein Produktbild in Katalogqualität zu besitzen. Verwaltete Plattformen wie ThredUp fotografieren Artikel zentral; Peer-to-Peer-Plattformen wie Poshmark und Vinted sind darauf angewiesen, dass Verkäufer ihr Smartphone auf ein Kleidungsstück richten, das über einem Stuhl hängt. Diese Bilder zu standardisieren ist Voraussetzung für visuelle Suche, Empfehlungssysteme und plattformübergreifendes Inventory-Matching. Virtual Try-Off wandelt ein einzelnes Foto des getragenen Kleidungsstücks in das flache, standardisierte Bild um, das jedes nachgelagerte System benötigt.

Das Gegenargument liegt auf der Hand: Wenn Try-On vollständig adoptiert würde und Retouren deutlich senkte, würde das nachgelagerte Bildproblem von selbst schrumpfen. Damit das funktioniert, müsste Try-On das Bracketing-Verhalten von 63 Prozent der Online-Käufer eliminieren und die 9 Prozent der Retouren adressieren, die die NRF als betrügerisch einstuft. Selbst die optimistischsten Try-On-Szenarien berühren ausschließlich Kaufentscheidungen. Retouren aufgrund falscher Geschenke, impulsiver Sinnesänderungen oder Wardrobing existieren unabhängig von der Qualität der Visualisierung. Try-Off konkurriert nicht mit Try-On; es operiert in einem Bereich, den Try-On nie zu erreichen beabsichtigt hatte.

Die Katalogökonomie erklärt, warum die Forschung so schnell an Fahrt gewann. Eine Marke mit 500 SKUs gibt jährlich 125.000 bis 250.000 Dollar für Produktfotografie aus. KI-Bildgenerierung hat diese Kosten für bestimmte Anwendungsfälle auf wenige Cent pro Bild gesenkt. Doch auch die Generierung eines neuen Bildes eines bestehenden Kleidungsstücks erfordert eine Referenz – und bei zurückgegebenen, weiterverkauften oder Einzelstücken ist die einzige verfügbare Referenz häufig ein Foto von jemandem, der es trägt. Die Autoren von TEMU-VTOFF formulieren die Aufgabe explizit als Antwort auf die Kosten, Produktbilder in Katalogqualität im großen Maßstab zu beschaffen. Die Forschungsgemeinschaft hat sich nicht durch Zufall auf Try-Off konzentriert; sie hat sich darauf konzentriert, weil das kommerzielle Signal laut war.

Try-On und Try-Off laufen auf denselben Diffusions-Architekturen. Die Lücke war konzeptueller Natur: Das Feld hat jahrelang perfektioniert, wie Kleidungsstücke am Körper aussehen – und nie gefragt, wie man sie wieder davon löst. Händler, die heute entscheiden müssen, wo sie ihre KI-Budgets einsetzen, stehen vor einer konkreten Wahl. Try-On hilft einem Käufer, einen Kauf zu antizipieren; Try-Off macht ein zurückgegebenes, weiterverkauftes oder neu katalogisiertes Kleidungsstück für den nächsten Käufer sichtbar. Das schwierigere kommerzielle Problem war immer das zweite.